MCP:让 AI 查完再答

一个你一定遇到过的问题

你让 AI 帮你综述一下 GLP-1 受体激动剂的心血管保护作用,它给你洋洋洒洒写了两页,列了 6 篇参考文献,看起来像模像样。

你抽了其中一篇去 PubMed 查——查无此文。

不是 DOI 错了,是这篇文章从来就没存在过。作者名字、期刊名称、发表年份,全是 AI "编"的。

这就是 L1-2 讲过的幻觉问题。但在 L1 的时候我们只是"知道了这个风险",现在到了 L3,是时候解决它了。

为什么 AI 给不了出处?

要理解这个问题,得回到 AI 的工作原理。

AI 的知识是"冻住"的

L1-2 讲过,大模型是通过大量文本训练出来的"语言预测机器"。训练完成之后,它的知识就定格在训练数据的截止日期了。

这意味着:

- 2024 年 12 月训练完成的模型,不知道 2025 年 1 月发布的新指南

- 它"知道"的文献,不是因为它有一个文献数据库可以查,而是因为训练数据里包含了相关文本的片段

- 它在回答时不是"去查"文献,而是在"回忆"训练数据中出现过的文字模式

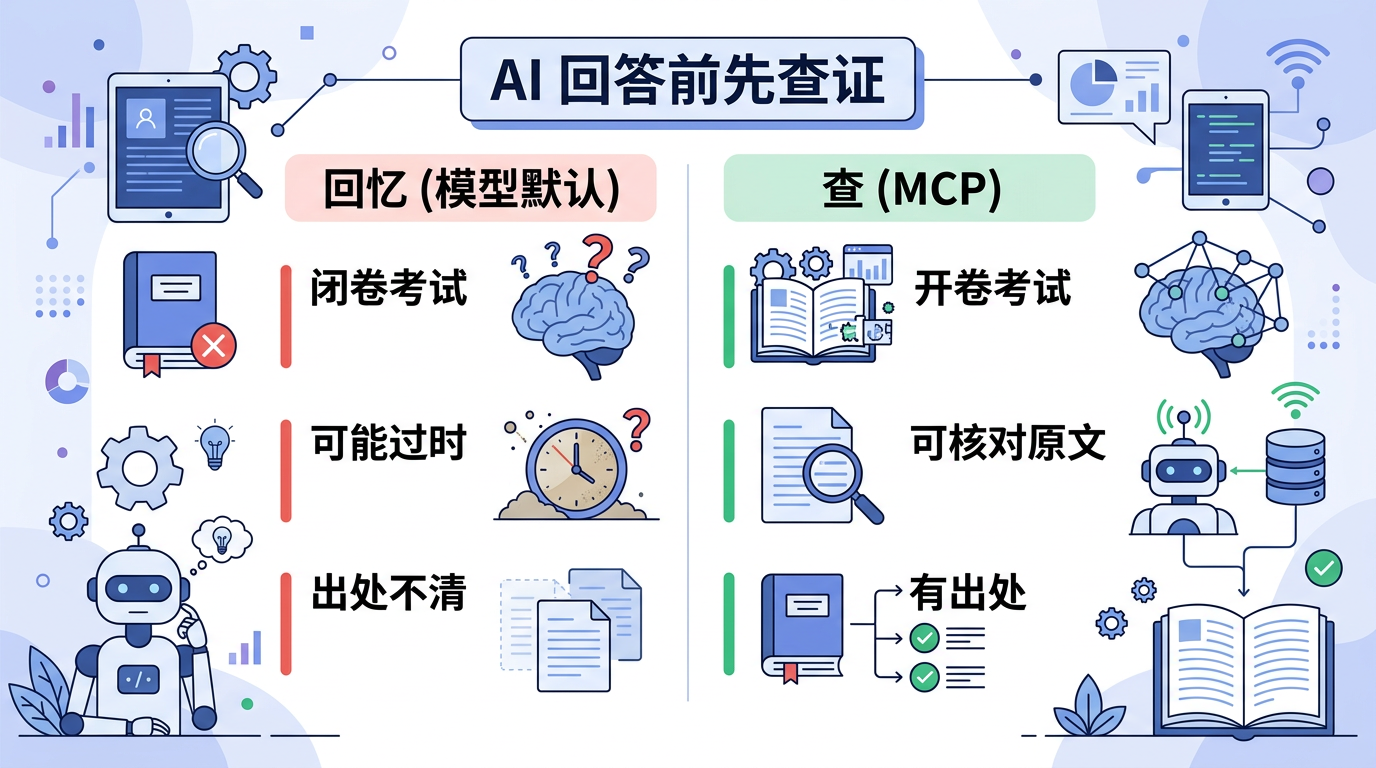

"回忆"和"查"有什么区别

这个区别对医生来说很好理解:

| "回忆"(通用 AI 的工作方式) | "查"(你日常的工作方式) | |

|---|---|---|

| 类比 | 闭卷考试 | 开卷考试 |

| 知识来源 | 以前学过/看过的内容 | 当场翻书、查 UpToDate、查 PubMed |

| 信息时效性 | 可能过时 | 查到的就是最新的 |

| 准确性 | 可能记错、记混、甚至"脑补" | 有原文可以核对 |

| 出处 | 通常说不出具体来源 | 可以标注页码、DOI、指南版本 |

你作为医生,做临床决策时不会仅凭记忆——你会翻指南、查 UpToDate、搜 PubMed。MCP 就是让 AI 也能这样做。

MCP 是什么

一句话解释

MCP(Model Context Protocol,模型上下文协议)是一套让 AI 调用外部工具和数据源的标准接口。

不用记这个英文名。你只需要知道:配了 MCP 之后,AI 回答问题的时候可以先去查专业数据库,查完再答。

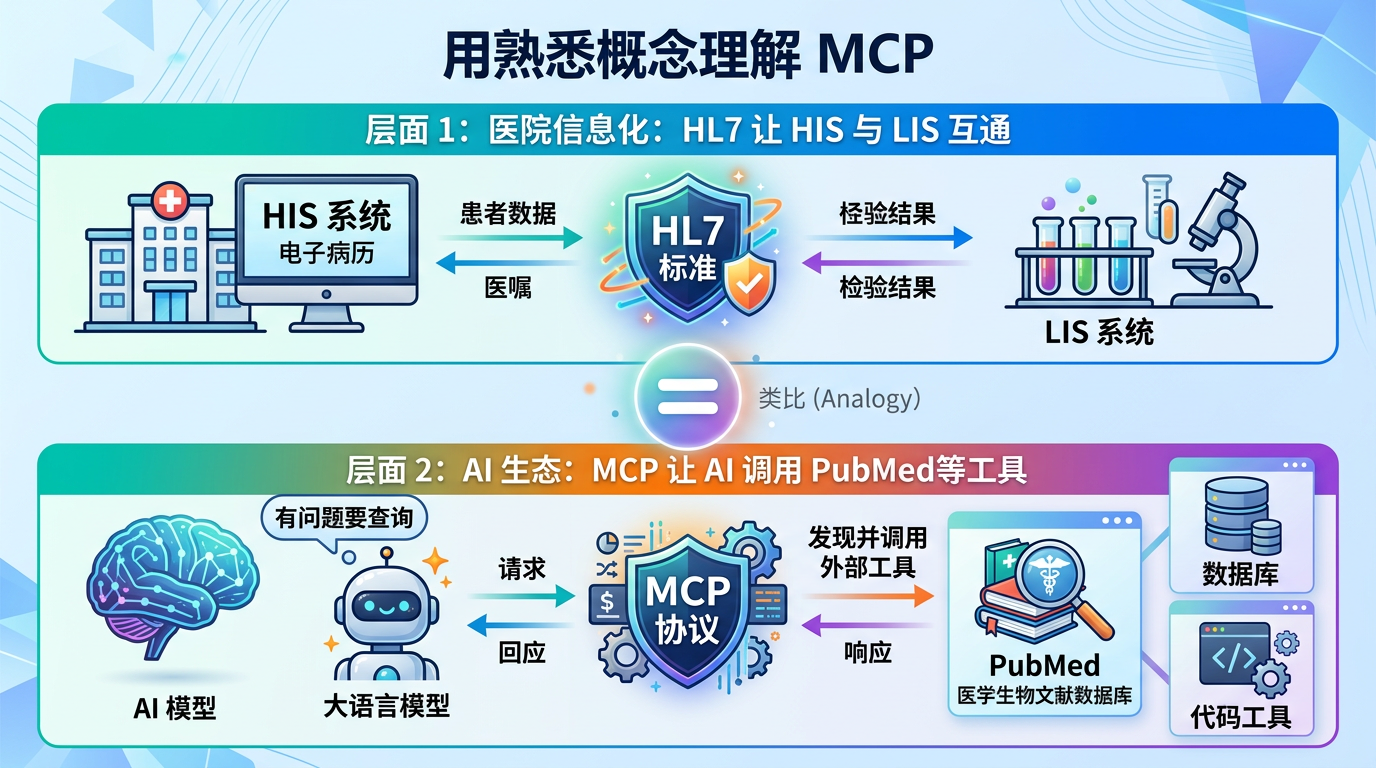

用你熟悉的概念理解

在医院里,不同科室的信息系统需要互通:LIS(检验系统)的结果要能在 HIS(医院信息系统)里看到,PACS(影像系统)的图要能调出来。为了让这些系统"说同一种语言",有一套标准协议叫 HL7。

MCP 做的事情类似——它是 AI 世界的"HL7":

| 医院信息化 | AI 生态 |

|---|---|

| HL7 协议 | MCP 协议 |

| 让 HIS 能调 LIS 的检验结果 | 让 AI 能调 PubMed 的文献数据 |

| 让不同厂商的系统互通 | 让不同的 AI 工具都能接入同一套外部服务 |

在 MCP 出现之前,如果你想让 AI 工具能查文献,每个工具得跟文献数据库单独对接一次

三个核心概念

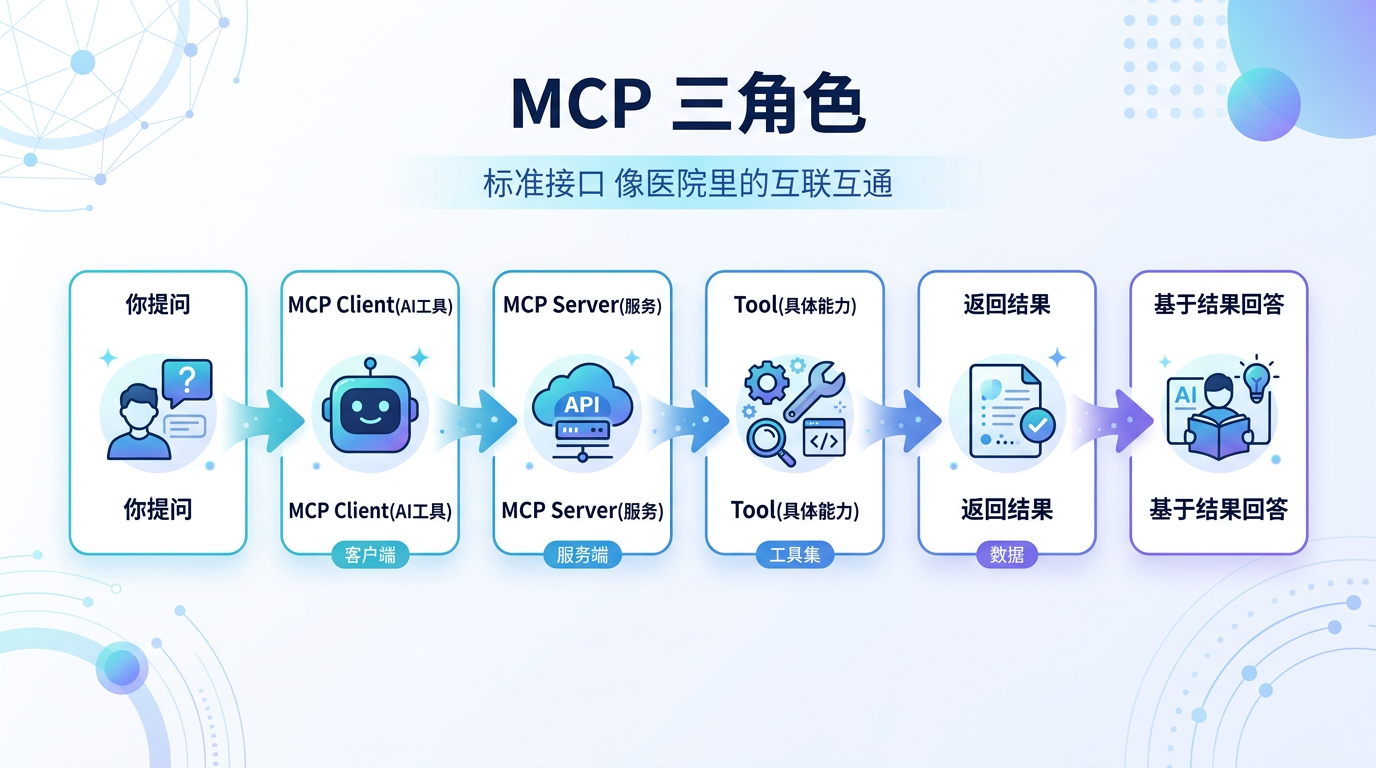

MCP 的世界里只有三个角色,记住它们的关系就够了:

你提问 → AI 客户端(MCP Client)接收

→ AI 判断"这个问题我需要查资料"

→ 通过 MCP 协议调用 MCP Server 的工具(Tool)

→ 工具返回检索结果

→ AI 基于结果组织回答

→ 你收到带出处的回答

| 角色 | 是什么 | 例子 |

|---|---|---|

| MCP Client | 你用的 AI 工具 | Cherry Studio、Cursor、Trae、扣子(Coze) |

| MCP Server | 提供某种能力的后台服务 | 百小应(循证检索)、PubMed MCP、Web Search MCP |

| Tool | 服务里的具体功能 | 文献检索、药物查询、指南检索 |

你不需要理解背后的技术实现——就像你不需要知道 HL7 的报文格式也能在 HIS 里查检验结果一样。你只需要知道:选一个 Client,接上一个 Server,就能用。

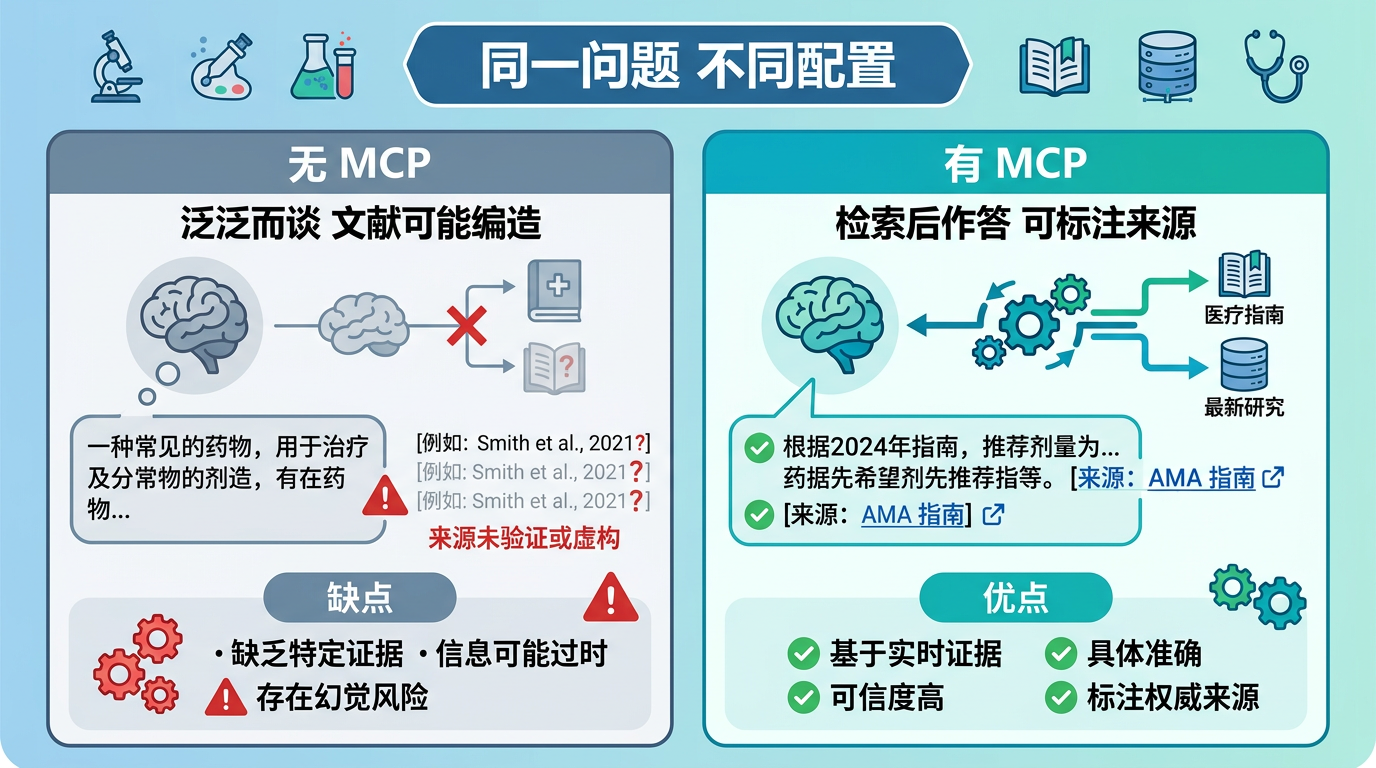

效果对比:有 MCP vs 没有 MCP

光讲概念没用,看效果。

下面是同一个提示词,分别用通用 AI(不配 MCP)和配了百小应 MCP 后的回答对比。我们挑三个最典型的场景:

场景一:文献综述

提示词:请帮我综述 GLP-1 受体激动剂的心血管保护作用,列出关键临床试验和参考文献。

| 不配 MCP | 配了百小应 MCP | |

|---|---|---|

| 回答质量 | 内容专业,按临床试验逐个介绍 | 额外给出作用机制表格 + CVOT 试验汇总对比表 |

| 参考文献 | 6 篇经典文献,有作者和期刊名,但没有原文链接 | 8 篇文献,含中英文来源,每篇附可点击的原文链接 |

| 最大差距 | 文献看起来真,但你得自己去 PubMed 逐篇搜索核实 | 点击链接直接跳转原文验证,30 秒内完成核实 |

场景二:复杂病例用药

提示词:72 岁男性,高血压 155/95mmHg,2 型糖尿病 HbA1c 8.2%,CKD 3b 期 eGFR 38,目前用药:氨氯地平 5mg qd、二甲双胍 500mg bid。请基于最新临床指南给出用药调整建议。

| 不配 MCP | 配了百小应 MCP | |

|---|---|---|

| 回答质量 | 分科给出建议,提到了"ADA 指南" | 同样分科建议,但每条建议带编号引用标注 [1][2]... |

| 出处标注 | 提到指南名称,但没有具体文献信息 | 每条引用含期刊、年份、原文链接,可直接验证 |

| 临床可操作性 | 建议合理但偏泛 | 给出具体剂量范围、监测计划和随访时间 |

场景三:药物相互作用

提示词:华法林与阿莫西林同时使用,是否存在临床显著的药物相互作用?

| 不配 MCP | 配了百小应 MCP | |

|---|---|---|

| 机制分析 | 详细(4 种机制),质量不错 | 同样详细,额外给出具体的 INR 监测阈值和处理方案 |

| 参考文献 | 引用 ACC 指南、Stockley's,但没有链接 | 5 篇文献均为 RCT 或病例研究,附可点击的原文链接 |

| 你能不能直接用 | 需要自己去核实引用是否真实 | 点击链接即可验证,敢用 |

对比总结

看完三个场景,差距不在"回答好不好"——通用 AI 的回答质量其实也不差。差距在"能不能验证":

| 通用 AI | 配了 MCP 的 AI | |

|---|---|---|

| 回答质量 | 7-8 分 | 8-9 分 |

| 引用可验证性 | ❌ 提到指南名但查不到具体文献 | ✅ 每条引用可点击跳转原文 |

| 你敢不敢直接用 | 得先自己核实一遍 | 核实成本极低,30 秒搞定 |

一句话总结:通用 AI 给你"看起来对的答案",MCP 给你"可以验证的答案"。在医疗场景下,这个区别决定了你敢不敢用。

💡 想看五个场景的完整对比(含截图),可以参考配套教程:《医疗从业者 MCP 实战教程》

动手配置:5 分钟搞定

选工具

| 工具 | 适合谁 | 特点 |

|---|---|---|

| Cherry Studio | 零基础新手(推荐) | 图形界面,点击配置 |

| Cursor / Trae | 有一定技术基础的用户 | AI 编程 IDE,功能更强 |

| 扣子(Coze) | 想搭建智能体的用户 | 可视化搭建,自带模型额度 |

新手从 Cherry Studio 开始就好,最简单。

用 Cherry Studio 配置百小应 MCP

第 1 步:下载安装 Cherry Studio

前往 cherry-ai.com 下载对应系统版本,安装后打开。

第 2 步:配置大模型

进入 设置 → 模型服务 → 选一个模型服务商(如百川、火山引擎)→ 填入你的 API 密钥。

API 密钥是模型厂商给你的一串字符,类似于"通行证"。大多数国产模型对新用户有免费额度,直接去官网申请即可。

然后在聊天界面,选择一个带扳手图标 🔧 的模型。这很重要——只有带扳手的模型才支持调用外部工具,没有扳手图标的不行。

第 3 步:添加百小应 MCP

进入 设置 → MCP 服务器 → 点击添加,填写:

- 名称:百小应 MCP(随便起,自己能认出来就行)

- 类型:选择"服务器发送事件 (sse)"

- URL:

https://baixiaoying-mcp-server.baichuan-ai.com/sse - 请求头:

Authorization=Bearer 你的密钥

密钥从百小应官网获取。保存后看到状态变为绿色,就配好了。

第 4 步:测试

回到聊天界面,点击输入框下方的扳手图标 🔧,选择"手动"模式,勾选百小应 MCP。

然后输入一个你工作中的真实问题试试,比如:

华法林与阿莫西林同时使用,是否存在临床显著的药物相互作用?请给出具体机制和参考文献。使用百小应 mcp

你会看到 AI 先显示"正在调用工具…",然后返回带出处的结构化回答。这就是 MCP 在工作。

配置第二个 MCP:Web Search

一个 AI 工具可以同时连接多个 MCP 服务。推荐再加一个 Web Search MCP(让 AI 能搜索网页信息),这样它既能查专业文献,也能搜最新资讯。

在 MCP 服务器中再添加一个服务即可。具体的 URL 和配置参数,可以在 mcp.so 上搜索 "web search" 找到。

配好两个之后,AI 会根据你的问题自动判断该调哪个——问文献的时候调百小应,问最新消息的时候调 Web Search。你不需要手动切换。

💡 更详细的配置步骤和截图,参见配套教程《医疗从业者 MCP 实战教程》中的"动手环节"章节。

MCP 的局限性

MCP 很好用,但不是万能的。用之前要清楚它的边界:

1. MCP 返回的信息不等于"绝对正确"

MCP 让 AI "查了再答",但: - 数据源本身可能有错误或过时(虽然概率比 AI 瞎编低得多) - AI 在整合检索结果时仍可能误读或曲解原文 - 你的专业审核仍然不可省略

2. MCP 不能访问你医院的内网系统

目前主流的 MCP 服务都是公网服务——它能查 PubMed、查指南数据库,但查不了你医院的 HIS、LIS、PACS。医院内网数据的对接需要信息科参与和单独技术方案,通识课不展开;若你后续学习更高阶课程,可能会再专门讲这一块。

3. 数据隐私仍然适用

L1-4 讲过的脱敏原则在使用 MCP 时同样适用。你的提问会被发送到 MCP Server 进行检索——所以不要在提问中包含患者的真实姓名、身份证号等可识别信息。

4. 不同 MCP 服务的质量差异很大

百小应接入的是权威医学数据库,可信度高。但 MCP 生态里也有很多质量参差不齐的服务。选择 MCP 服务时,关注它背后的数据源是什么。

从"凭记忆答"到"查完再答"

在 L3-1 我们把提示词"固化"成了 Skill,解决了效率问题。

这一节我们用 MCP 解决了可信度问题——AI 的回答从"凭记忆猜"变成了"查完再答",从"你得自己去核实"变成了"给你原文链接自己点"。

但还有一个问题没解决:MCP 能让 AI 查公共数据库,可是你们科室自己的指南、规范、操作手册怎么办? 这些东西不在任何公开数据库里,MCP 查不到。

这就是下一节要解决的问题——知识库(RAG)。

动手试一试

- 配置 MCP:在 Cherry Studio(或你习惯的工具)上配好百小应 MCP,确认能正常调用

- 对比测试:选一个你工作中常遇到的问题,分别在有 MCP 和没有 MCP 的情况下问一遍,对比回答质量和引用可验证性

- 加第二个 MCP:尝试再配一个 Web Search MCP,体验多工具协作

- 验证引用:拿到 MCP 回答后,点开引用链接验证 1-2 篇——确认引用是真实的,同时建立"即使有 MCP 也要抽查"的习惯

本节小结

| 概念 | 一句话 |

|---|---|

| AI 的知识"冻结" | 训练完成后知识定格,无法获取新信息、无法查数据库 |

| MCP | 让 AI 调用外部工具的标准接口——查完再答,不是瞎编 |

| MCP 三角色 | Client(你用的工具)→ Server(提供能力的服务)→ Tool(具体功能) |

| MCP vs 通用 AI | 通用 AI 给"看起来对的答案",MCP 给"可以验证的答案" |

| MCP 的局限 | 不是万能的——返回信息仍需审核、不能访问内网、要注意脱敏 |

本节带走:

- 至少 2 个配置好的 MCP 服务(百小应 + Web Search)

- 一个核心认知转变:从"AI 说什么你就信什么"到"AI 查完给你看出处,你自己判断"。 这不只是一个工具配置的变化,是你和 AI 协作方式的根本升级

- L3-1 解决了效率(Skill),L3-2 解决了可信度(MCP),下一节解决定制化(你自己的资料)